想象一下,曾經(jīng)只能通過后期制作的特效,如今卻能實時呈現(xiàn)在觀眾眼前。無論是將“馬斯克AI女友”瞬間轉(zhuǎn)換為哥特或卡哇伊風格,還是讓家中的寵物狗穿上蜘蛛俠戰(zhàn)衣,在MirageLSD的魔力下,一切皆有可能。這一技術(shù)不僅限于簡單的濾鏡效果,而是能夠深刻理解視頻內(nèi)容,并據(jù)此生成無限想象力的AI視頻。

MirageLSD之所以能夠?qū)崿F(xiàn)實時生成,得益于Decart自研的Live Stream Diffusion(LSD)模型。該模型能夠在保持時間連貫性的同時,逐幀生成視頻,并支持完全交互式的視頻合成。用戶可以在視頻生成的過程中,持續(xù)進行提示、變換和編輯,從而創(chuàng)造出獨一無二的個性化視頻內(nèi)容。

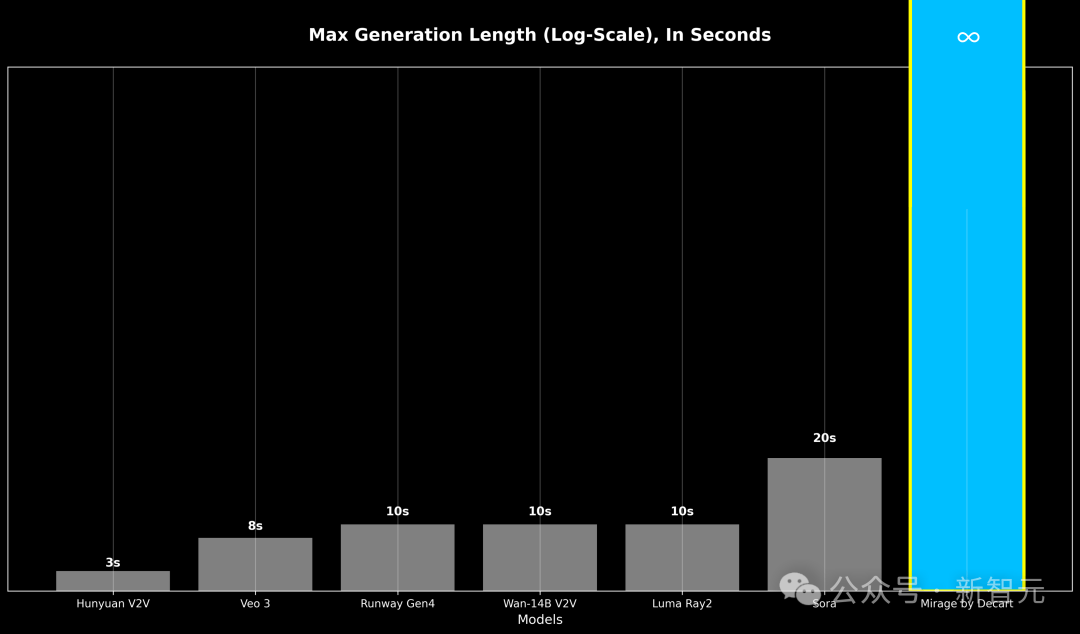

與傳統(tǒng)的視頻生成模型相比,MirageLSD不僅解決了誤差累積導(dǎo)致的質(zhì)量下降問題,還實現(xiàn)了無限長度的視頻生成。這得益于其采用的DiffusionForcing技術(shù)和歷史增強技術(shù),使得模型能夠在經(jīng)過損壞的歷史幀輸入上進行微調(diào),預(yù)測并修正輸入中的偽影,從而增強了對自回歸生成中常見漂移的魯棒性。

為了實現(xiàn)實時性能,MirageLSD在模型設(shè)計和系統(tǒng)執(zhí)行方面都進行了重大優(yōu)化。通過設(shè)計自定義的CUDA超大內(nèi)核、減少每幀所需的計算量以及優(yōu)化模型架構(gòu)與GPU硬件的對齊,MirageLSD成功地將響應(yīng)速度提高了16倍,實現(xiàn)了每秒24幀的實時視頻生成。這一突破性的成就,無疑為未來的視頻娛樂、直播互動等領(lǐng)域帶來了無限的想象空間。